Категория: Руководства

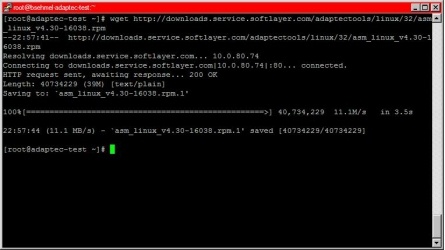

Просто скачать файл wget-ом:

Для продолжения оборвавшейся закачки пишем:

Как и в других программах, ключи имеют короткую и длинную формы, и вместо -с можно написать -continue. Длинные ключи проще запомнить, но дольше писать. Можно легко смешивать различные формы написания.

Чтобы выкачать файлы из списка. содержащего прямые ссылки:

Здесь указывается только файл, в котором содержатся ссылки. Файл может так же быть HTML -страницей, в которой есть ссылки. Они будут выкачаны указанной выше командой.

Использование а-ля «Teleport Pro for Linux».

При скачивании веб-сайтов возможностей больше, и поэтому требуется больше ключей. Опять-таки, запоминать их все не обязательно, можно сделать скрипт (а лучше несколько - под разные случаи) и вызывать их.

Так вот, если имеется веб-сайт, и хотелось бы иметь его локальную копию на компьютере, чтобы, отключившись от сети, можно было не торопясь его почитать.

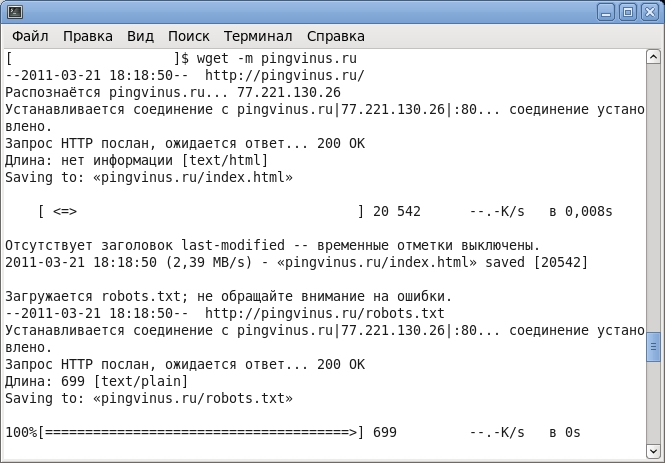

Зеркалирование сайтов на локальную машину:

-m эквивалентно -r -N -l inf -nr. эти опции описаны ниже.

При этом ссылки останутся абсолютными - то есть, будут указывать на Интернет-адреса, и удобно просматривать на локальной машине будет затруднительно.

Копирование сайта для локального просмотра (с заменой интернет-ссылок на локальные адреса скачанных страниц):

При этом будет включена рекурсивная выгрузка (ключ -r, –recursive),

В wget имеется большое количество полезных опций - побольше, чем у Teleport'а флажков. Будучи завёрнутым в скрипт, например, teleport и положенным на видное место (указанное в PATH ), имеем удобство применения и богатство настроек.

-np. –no-parent — не подниматься выше начального адреса при рекурсивной загрузке.

-r. –recursive — включить рекурсивный просмотр каталогов и подкаталогов на удалённом сервере.

-l <depth>. –level=<depth> — определить максимальную глубину рекурсии равной depth при просмотре каталогов на удалённом сервере. По умолчанию depth=5.

-np. –no-parent — не переходить в родительский каталог во время поиска файлов. Это очень полезное свойство, поскольку оно гарантирует, что будут копироваться только те файлы, которые расположены ниже определённой иерархии.

-A <acclist>. –accept <acclist>. -R <rejlist>. –reject <rejlist> — список имен файлов, разделенных запятыми, которые следует (accept) или не следует (reject) загружать. Разрешается задание имен файлов по маске.

-k. –convert-links — превратить абсолютные ссылки в HTML документе в относительные ссылки. Преобразованию подвергнутся только те ссылки, которые указывают на реально загруженные страницы; остальные не будут преобразовываться. Заметим, что лишь в конце работы wget сможет узнать какие страницы были реально загружены. Следовательно, лишь в конце работы wget будет выполняться окончательное преобразование.

–http-user=<user>. –http-passwd=<password> — указать имя пользователя и пароль на HTTP -сервере.

-H. –span-hosts — разрешает посещать любые сервера, на которые есть ссылка.

-p. –page-requisites — загружать все файлы, которые нужны для отображения страниц HTML. Например: рисунки, звук, каскадные стили (CSS ). По умолчанию такие файлы не загружаются. Параметры -r и -l. указанные вместе могут помочь, но т.к. wget не различает внешние и внутренние документы, то нет гарантии, что загрузится все требуемое.

man wget — документация на русском языке

Автор: Человек Гриф

Для закачки со Всемирной Паутины изображений, страничек, файлов применяют инструмент - WGET.

Для закачки со Всемирной Паутины изображений, страничек, файлов применяют инструмент - WGET.

Он разрабатывался первоночально для ОС Linux and Unix, как инструмент командной строки, в последствии портированный на Windows. Его можно применять как инструмент для скачивания сайта полностью, со всеми изображениями и файлами. Содержимое будет находится у вас на винчестере. Такой инструмент полезен при резервном копировании сайта.

1. Скачиваем и извлекаем «WGET» для ОС «Windows» с сайта gnuwin32.sourceforge.net.

2. Жмем «Все программы» в меню «Пуск».

3. Жмем опцию «Стандартные».

4. Жмем «Командная строка», для открытия соответствующего окна.

5. Введим «path» (без кавычек) в командную строку, для того чтоб определить каталог, в который мы поместим файл «Wget.exe», после этого его можно запускать при помощи одной команды. У вас получиться примерно такое: «c:\Windows\system32;c:\Windows».

6. Копируем распакованный файл «wget.exe» в папку «Windows\system32», либо в папку «Windows».

7. Введим в командную строку «wget -h», чтобы убедиться в том, что приложение запускается.

8. В командной строке введем «wget -r http://dirfreesoft.ru », для закачки всего содержимого сайта по указанному адресу. Замените «dirfreesoft.ru» на любой другой адрес сайта, который нужно закачать на компьютер.

Комментарии--cut-dirs=1 -> ftp.xemacs.org/xemacs/

popular/page/Например: если загруженный файл /foo/doc.html, ссылка на файл /bar/img.gif, также загруженный, в

нём будет выглядеть как. /bar/img.gif. Этот способ работает, если есть видимое соотношение между

каталогами одного и другого файла.

Например: если загруженный файл /foo/doc.html содержит ссылку на /bar/img.gif (или на

. /bar/img.gif), ссылка в файле doc.html изменится на http://host/bar/img.gif .

Символ амперсанда в конце указывает командному интерпретатору продолжать работу с пользователем, не

дожидаясь завершения работы Wget. Чтобы программа делала повторы бесконечно используйте -t inf .

Если вы укажите - вместо имени файла, URL будут читаться из стандартного ввода (stdin).

HTML страница будет сохранена в http://www.server.com/dir/page.html и рисунки, каскадные стили и прочее

будет сохранено в каталоге http://www.server.com/. кроме случая, когда файлы будут загружаться с других

серверов.

-r -l1 включает рекурсивную загрузку с максимальной глубиной в 1. --no-parent выключает следование по ссылкам в родительский каталог, имеющую верхний уровень, -A.gif разрешает загружать только файлы с расширением .GIF. -A "*.gif" также будет работать.

Если вы хотите устроить конвейер и загрузить все сайты, ссылки на которые указаны на одной странице:

Wget - неинтерактивный менеджер закачек, что значит, что все операции по загрузке будут проводиться в фоне. Вы можете загружать любые файлы из интернета с помощью команды wget. Wget также позволяет пользователю загрузить веб-сайт. Процесс загрузки начинается с простой команды wget, затем адрес веб-сайта. Этот пост включает все руководства по команде wget, которую можно использовать как менеджер закачек в Linux, а также для других различных целей. Wget поддерживает протоколы HTTP, HTTPS и FTP для загрузки файлов.

Загрузка веб-страниц, используя wget

Например, вы хотите загрузить главную страницу сайта freshtutorial.com. Вам нужно просто выполнить команду:

Начнётся загрузка, и файл будет сохранён в вашей домашней директории для дальнейшего использования в оффлайне. Теперь давайте представим, что у вас появилась проблема, или у удаленного сервера возникли какие-либо неполадки. Wget по умолчанию пытается повторно подсоединиться к серверу двадцать раз. Вы можете изменить этот лимит следующей командой:

wget -t freshtutorial.com

Теперь wget будет пытаться восстановить соединение с сервером восемь раз. Команда выше загрузит только файл index.html. Что же сделать, если вы хотите загрузить веб-сайт или страницу полностью? Команда ниже загрузит веб-сайт до пятого уровня вложенности

wget -r freshtutorial.com

Чтобы сконвертировать весь веб-сайт для оффлайн-просмотра, вы можете использовать следующую команду

wget --convert-links -r linux.about.com -o logfile

Загружаем и восстанавливаем ваши загрузки, используя Wget

Представим, что вы загружаете файл, как тут внезапно отключился Интернет. Используя wget, вы можете возобновлять ваши загрузки. Чтобы загрузить файл, просто откройте ваш терминал и введите команду wget, а затем URL. Например

Теперь, что если вы загружаете большой файл, например, игру, и соединение с сервером разорвалось? Теперь вам нужно начать загружать файл с начала, если вы не использовали никакого менеджера закачек. Wget позволяет вам загружать файлы с того момента, как вы отключились от сети. Для этой цели, мы будем использовать следующую команду:

wget -c http://wordpress.org/extend/themes/download/evolve.1.2.2.zip

Это возобновит вашу загрузку.

Загружаем динамический веб-сайт в статичную локальную копию

А что, если вы хотите загрузить динамический веб-сайт, например на WordPress, Joomla или Durpal, в котором многие вещи хранятся в базе данных? Для этой цели вы можете использовать следующую команду, которая сконвертирует все динамичные веб-страницы в статичные, которые вы сможете использовать локально, без сети

wget --mirror --convert-links URL

wget --mirror --convert-links freshtutorial.com

Для этой цели мы будем использовать следующую команду в терминале

wget -r --spider URL

wget -r --spider freshtutorial.com

Если Вы не знаете как узнать ip адрес сайта. почитайте об этом на meoblog.ru.

Очень часто при просмотре web-страниц выскакивают сообщения рекламного характера, которые сильно раздражают и сбивают с толку. Если вы входите в число этих людей, то должны знать, как отключить уведомления в.

На днях стал доступным релиз обновленного веб-браузера от Mozilla. Представленный Firefox 50 выпущен в версиях для десктопов с популярными операционными системами, а также для мобильных устройств, работающих на Android. Одним.

Ноутбуки вещь до конца не изученная пользователями, настолько как компьютер. Ведь не каждый захочет разбирать свой ноутбук, и смотреть как он устроен. В отличие от ноутбука компьютер разбирал почти каждый.

После приобретения смартфона большинство сразу же начинают выбирать аксессуары к нему. Это вполне объяснимо, поскольку многие из них делают эксплуатацию девайса безопасной и более комфортной. В первую очередь это касается.

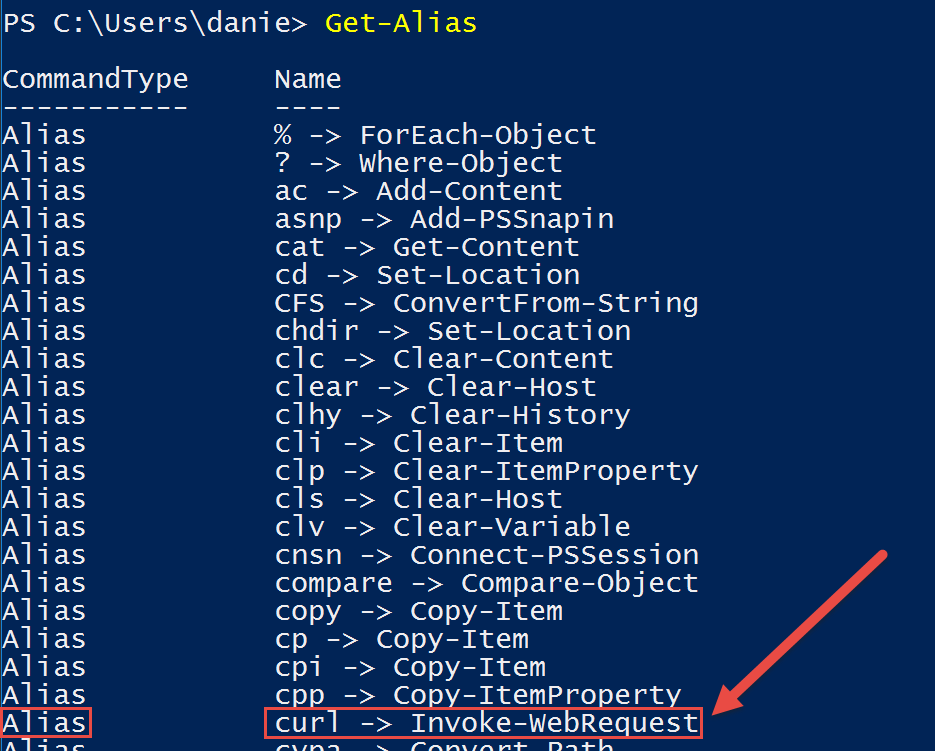

Wget — это довольно популярная не-интерактивная консольная утилита для загрузки файлов. Её не-интерактивность выражается в том, что после её запуска пользователь может повлиять на её работу только с помощью средств управления процессами самой операционной системы.

Это значит, что процесс загрузки никак не контролируется. Можно только либо прервать работу сочетанием клавиш Ctrl+C, либо отправить в фон сочетанием Ctrl+Z.

Wget очень лёгок в использовании, а так же поддерживает протоколы HTTP, FTP и HTTPS, поэтому так часто используется в различных руководствах по работе с терминалом, установки программ и прочего.

Часто многие пользователи даже не знают дополнительные функции команды wget. А их довольно много.

К примеру можно скачать страничку любого сайта, что и показано на скрине выше. Для этого нужно воспользоваться следующей командой:

Вместо ubuntovod.ru введите адрес до нужной странички.

Либо скачайте весь сайт целиком:

wget -r -l 10 -k ubuntovod.ru

Или вам нужно за один раз скачать множество файлов. Для этого просто запишите все ссылки (каждая ссылка с новой строки) в файл и воспользуйтесь такой командой: